El 28 de abril de 2026, el Poder Judicial del Estado de Querétaro, México, firmó las primeras sentencias elaboradas con apoyo de inteligencia artificial generativa en México: un divorcio incausado en el Juzgado Sexto Familiar y un juicio ejecutivo mercantil en el Juzgado Noveno Civil.1 El sistema se llama SON-IA, opera sobre un servidor propio del tribunal y utiliza un Modelo de Lenguaje de Gran Escala (LLM por sus siglas en inglés) para estructurar sentencias a partir de expedientes electrónicos.2 El magistrado presidente lo presentó como un hecho inédito en México y América Latina.3

Y algo inédito es, sin duda, en México. Pero la conversación pública que lo rodea está concentrada en la pregunta equivocada.

Lo que todos discuten

La cobertura mediática, desde La Jornada4 hasta Foro Jurídico5, pasando por El Imparcial6 y los medios locales, se ha centrado en dos temas: la seguridad de los datos y la promesa de que la IA no sustituye al juez. Menuda historia. Sobre lo primero, Querétaro tomó la decisión de alojar el sistema en un servidor propio, con cifrado y sin dependencia de plataformas comerciales en la nube.7 Sobre lo segundo, los Lineamientos para el uso responsable de IA, publicados en La Sombra de Arteaga el 24 de octubre de 2025, establecen que toda resolución asistida debe ser revisada y validada por una persona juzgadora, con una leyenda obligatoria que lo certifique.8

Ambos temas son relevantes. Pero ninguno toca el problema de fondo.

Lo que nadie pregunta

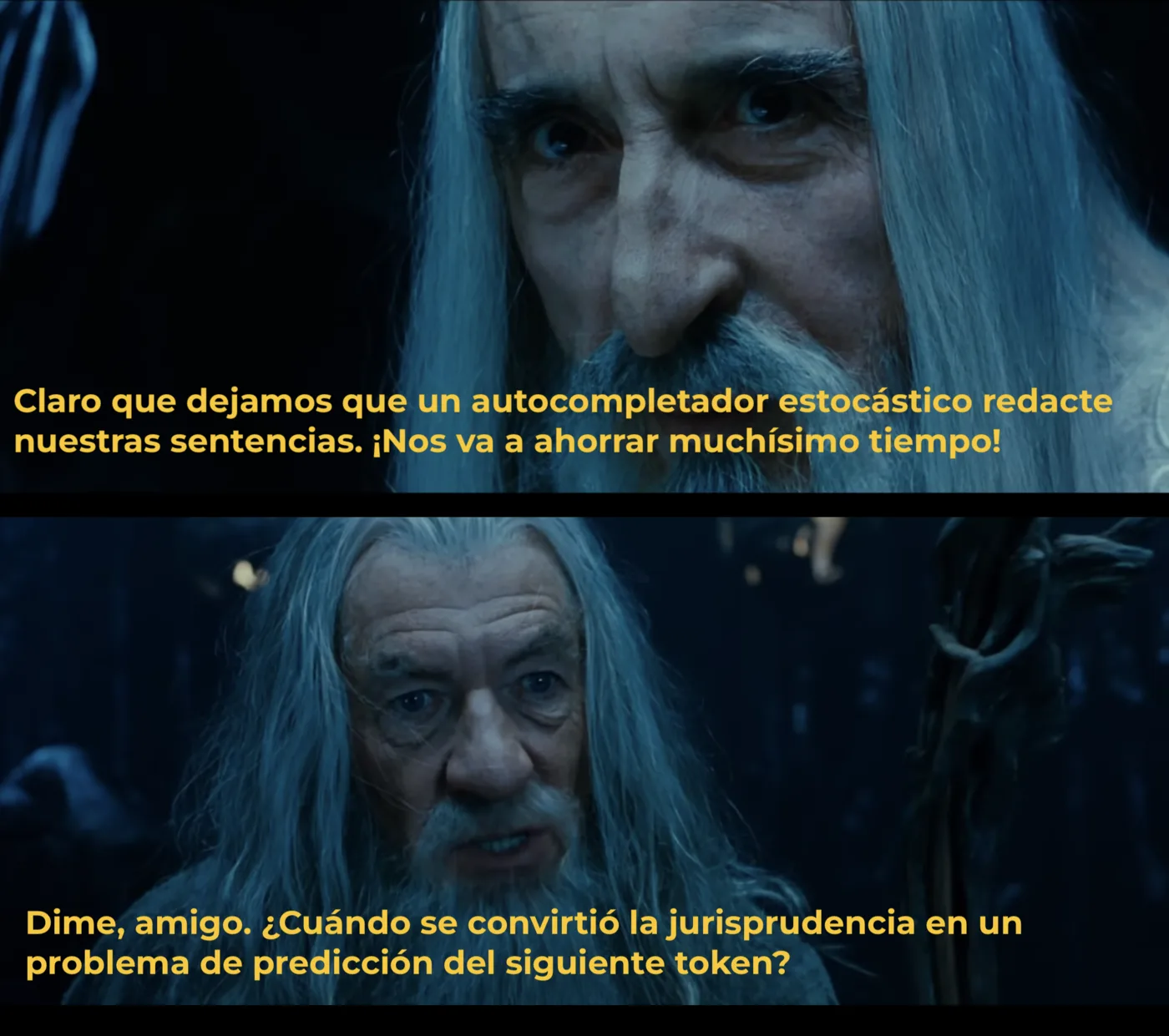

Un LLM no razona. Permite predecir qué secuencia de tokens es estadísticamente más probable dado un contexto. Me gusta repetirlo aunque se enojan algunos: es un loro estocástico. Literalmente. Rechazo la narrativa de las competencias emergentes que repiten hasta después de la saciedad los discípulos de Silicon Valley. Cuando se le pide que estructure una sentencia a una IA, no estamos aplicando derecho a hechos. Estamos generando texto que se parece a lo que una sentencia parece en un corpus de entrenamiento. La diferencia es invisible en el resultado… hasta que no lo es. Porque la naturaleza de la operación lo vuelve un error epistémico, que produce necesariamente una erosión de la justicia.

La jurisprudencia en el sentido clásico, romano, el que México heredó, es iuris prudentia: la prudencia del derecho, el juicio razonado sobre lo justo en un caso concreto. Implica interpretación de la norma, valoración de la prueba, ponderación de principios en tensión, un silogismo jurídico que conecta premisa mayor (norma), premisa menor (hechos) y conclusión (decisión), en un movimiento y una experiencia de una realidad social compartida por una persona de carne y hueso, quien firma y entiende lo que se podría sentir estar del otro lado del espejo. Cada uno de esos pasos es un acto de juicio, lo cual es fundamentalmente diferente de un acto de predicción semántico.

Cuando se sustituye ese acto de juicio por una predicción estadística del próximo token, lo que se obtiene es una sentencia que suena correcta pero que fue generada en vez de ser razonada, lo cual es violatorio del debido proceso. Y el juez que la revisa y valida no está verificando un razonamiento, pues no hubo razonamiento, sino que está verificando si el texto le parece razonable. Que es exactamente lo que un LLM está optimizado para producir: texto que parece razonable. La circularidad retórica de esto sería estética si no fuera tan dramático que ocurra en el ejercicio de una facultad soberana del Estado.

La función jurisdiccional consiste en el ejercicio del juicio sobre un caso concreto. Un predictor de tokens ejerce algo radicalmente distinto: produce la respuesta más plausible, no la más justa. ¿Y qué?, me dirán, si el resultado es indiscernible de la simulación, ¡el funcionalismo nos dice que todo está en orden!

No. El funcionalismo no nos dice que todo está en orden.

Lo primero es que ni siquiera el padre del funcionalismo lo sostendría: Hilary Putnam formuló la tesis en 19679 y la abandonó él mismo veinte años después,10 al concluir que los estados funcionales no pueden dar cuenta de las propiedades centrales de los estados mentales (creencia, razonamiento, racionalidad), es decir, de la capacidad de formar y poseer razones, no solo de producir outputs que se parecen a razones.

Lo segundo es que incluso si aceptáramos la premisa funcionalista, un LLM no la cumple: Putnam describía estados mentales como estados de un sistema completo que media causalmente entre inputs, estados internos persistentes y outputs a lo largo del tiempo. Un transformer tiene prompt, forward pass y tokens. Como lo afirma un ensayo de Aeon que va a celebrar sus 10 años, ¡nuestros cerebros no funcionan como computadoras!11 Get over it. No hay estados internos que medien entre múltiples interacciones. No hay integración sistémica. No hay cuerpo.

Y lo tercero es que el neurólogo Antonio Damasio demostró empíricamente con pacientes con lesión ventromedial que no existe razonamiento puro desligado de marcadores somáticos: incluso para lógica formal, análisis jurídico o estrategia, los humanos necesitamos señales emocionales para evaluar relevancia, priorizar opciones y detectar contradicciones significativas.12 Un LLM permite producir outputs que nosotros evaluamos como lógicamente correctos, pero sólo estamos recuperando patrones estadísticos. En otras palabras: el razonamiento humano implica evaluar significancia. Con IA, manipulamos símbolos. Y algunos, impresionados por eso, confunden el mapa con el territorio. Confundir la utilidad funcional de un autocompletador con el proceso cognitivo de juzgar es, precisamente, la confusión de categorías sobre la cual se construye SON-IA, y muchos otros usos de IA degenerativa en la justicia.13 Profundizo este argumento, junto con Ilsse C. Torres Ortega, en mi paper de investigación más reciente — disponible junto al resto de mi obra académica en mis publicaciones.

Lo que sabemos (y lo que no) sobre SON-IA

Hay que ser justos: el Poder Judicial de Querétaro hizo algo que ninguna otra institución judicial en México se ha atrevido a hacer, y lo hizo con más estructura que la que la cobertura mediática permite apreciar.14 Publicó lineamientos éticos antes de la implementación,8 condujo un piloto de seis meses en dos juzgados específicos,15 definió un alcance limitado a asuntos de baja complejidad (divorcios incausados, jurisdicción voluntaria, juicios ejecutivos mercantiles por pagaré),16 y estableció la supervisión humana obligatoria como condición normativa. Nada de eso es trivial.

Sin embargo, varias preguntas fundamentales no tienen respuesta pública:

¿Qué problema se intenta resolver y si la IA generativa es la herramienta correcta para eso? Porque no he visto, en ningún lado, alguna señal de que se hayan considerado tecnologías alternas, soluciones low tech, o incluso tecnologías más robustas como algoritmos de IA neurosimbólica a la medida.

¿Qué modelo se usa? En ningún comunicado oficial, ni en los boletines del tribunal de los últimos seis meses, ni en las entrevistas del magistrado presidente, se identifica el modelo de lenguaje subyacente.17 Sabemos que no es ChatGPT, Gemini ni Claude, expresamente prohibidos por la institución.7 Sabemos que opera en un servidor local. Pero no se ha publicado si es Llama, Mistral, Qwen u otro modelo de código abierto. Saber qué modelo produce las sentencias es condición mínima para evaluar sus sesgos. La cuestión de si hay una violación de los Lineamientos para el uso responsable de IA, de los cuales se cuelgan para el piloto, es real.

¿Qué significa «entrenamiento de seis meses»? El magistrado presidente declaró: «entrenamos a nuestro robot durante seis meses para estar siendo especializado en derecho».4 Pero la jueza titular del Juzgado Sexto Familiar describe el proceso en términos más concretos: «hemos desarrollado prompts para tres tipos de resoluciones».7 Hay una distancia técnica enorme entre entrenar un modelo (modificar sus pesos con datos nuevos) y desarrollar prompts (escribir instrucciones para un modelo existente). La documentación pública no permite distinguir cuál de las dos cosas ocurrió.

¿Quién evaluó la calidad? El magistrado presidente declaró que tras los ensayos piloto, el sistema permite emitir documentos «con alta pulcritud»6 y en otra ocasión afirmó que lo hacen «con perfección sin sesgos».4 Estas afirmaciones no están respaldadas por una evaluación independiente publicada. No hay benchmarks, ni comparación ciega entre sentencias humanas y sentencias asistidas, ni auditoría de terceros. Los propios lineamientos asignan el monitoreo a la Dirección de TI, es decir, al mismo equipo que construyó el sistema.8 Evaluar tu propio producto es simplemente marketing. Y cualquier estudiante de licenciatura en ciencia de datos puede oler la trampa cuando se declara que no hay sesgos o alucinaciones en un modelo de IA generativa.

El problema que el servidor local no resuelve

La decisión de Querétaro de operar con infraestructura propia en lugar de depender de un proveedor de nube estadounidense tiene sentido desde la perspectiva de la soberanía de datos. Un poder del Estado no debería depender contractualmente de OpenAI, de AWS o de Google para custodiar los expedientes judiciales de sus ciudadanos. Eso está bien resuelto.

Pero la soberanía de datos no es soberanía cognitiva.

El servidor está en Querétaro. Pero el modelo que razona sobre los expedientes fue entrenado (sea cual sea) predominantemente con texto en inglés y con corpus jurídico anglosajón. Los LLM actuales, incluso los de código abierto, absorben patrones de razonamiento del common law: precedente vinculante, sistema adversarial, estándar de reasonableness, stare decisis. El sistema jurídico mexicano opera con otra lógica: codificación, principio de legalidad, jurisprudencia con reglas de reiteración, el juez como aplicador de la norma.

Cuando usan a SON-IA para fijar la litis o ponderar la prueba, ¿con qué patrones lo hacen? ¿Priorizan precedente sobre norma? ¿Estructuran el silogismo jurídico como lo haría un juez formado en tradición romanista, o como lo haría un modelo que leyó millones de rulings federales estadounidenses? Estas preguntas no se resuelven con un servidor propio enfriado por aire (argumento que se mencionó para justificar que se ha pensado a fondo el asunto).4

Y hay un agravante: este sesgo no se manifiesta como un error de hecho que el juez pueda detectar. No es una fecha equivocada ni una ley mal citada. Es una forma de estructurar el argumento, de ponderar los elementos, de organizar la decisión, de priorizar las fuentes jurídicas. Es invisible precisamente porque el LLM está optimizado para producir texto que parece correcto. Pero el riesgo está en el abandono de la función de juzgar, porque escribir una sentencia es decidir, de primera mano, lo que tiene que contener y por qué. Y creo que es la primera vez en la historia que un juez, cuya función es escribir el derecho o volverlo perfecto, acepta dejar la mano y transformarse en revisor de algo escrito de forma automática. Invocando la eficiencia. Con la pregunta de si realmente la escritura de la sentencia era el cuello de botella en términos de eficiencia de la justicia. Pero eso es pregunta para otro artículo.

La pendiente resbaladiza

El escándalo no está en los divorcios. Está en lo que viene después. El magistrado presidente ya anunció la extensión a otros juzgados y mencionó explícitamente la materia penal.7 La lógica es previsible: si funciona con divorcios, ¿por qué no con pensiones alimenticias? Si funciona con pagarés, ¿por qué no con controversias complejas? Cada éxito aparente en un escalón de baja complejidad se convierte en justificación para subir al siguiente. Sobre todo porque “la IA se mejora”.

Y aquí entra el espejismo de las scaling laws: la idea de que los modelos, al crecer en parámetros, se vuelven progresivamente más inteligentes. Los outputs mejoran, sí: se vuelven más difíciles de distinguir del texto humano. Pero mejorar la predicción del próximo token no es adquirir capacidad de juicio. La distancia entre simulación y juicio no se cierra con más parámetros, pues es de naturaleza, no de grado.

La presión es real, pero la respuesta a un sistema judicial sobrecargado no es automatizar el juicio. Es automatizar todo lo que rodea al juicio (búsqueda, transcripción, gestión documental, anonimización, y este último lo están atacando en Querétaro con SON-IA), sin delegar el acto de juzgar a un proceso que, por definición, no juzga.

Lo que el debate debería incluir

La cobertura de SON-IA oscila entre dos polos: el entusiasmo acrítico y el temor genérico. Ninguno de los dos aborda las cuestiones importantes desde mi punto de vista, que voy a detallar a continuación.

Para las instituciones del Estado que quieran adoptar IA en la función jurisdiccional

Las preguntas son de naturaleza epistémica: ¿es compatible la predicción estadística de tokens con la obligación constitucional de fundamentar y motivar? ¿Puede un justiciable impugnar el razonamiento de una sentencia que… no fue razonada? Porque obviamente, habrá sentencias que ni siquiera pasarán por el filtro de la revisión por un juez que, por eficiencia o cualquier otra razón, solamente pondrá su sello de revisado. Me dirán que los jueces ya delegan a proyectistas, ya usan machotes sin revisar, ya cometen errores, entonces ¿qué tiene de malo que deleguen a una máquina?

Por supuesto, todo depende de cómo se utilice el modelo. Pero en su versión generativa básica, lo malo es que cambia la naturaleza del problema. Un proyectista que redacta una sentencia mal fundamentada está razonando mal: identificó hechos, intentó aplicar una norma, construyó un silogismo deficiente. Su error es corregible porque es un error de juicio. Usar un LLM para generar una sentencia plausible es no razonar en absoluto. Su output es una predicción estadística disfrazada de juicio. Y cuando el juez firma sin revisar (lo cual, concedamos, ya sucede), en un caso delegó su juicio a otro ser humano que al menos lo ejerció. En el otro, lo delegó a un proceso que por definición no puede ejercerlo. El problema no mejora con IA: se blanquea y se esconde detrás del tecnosolucionismo. Porque la sentencia generada con un LLM parece más pulcra, más estructurada, más correcta que la del proyectista exhausto, es precisamente eso lo que la hace más peligrosa. Un juez aburrido, con hambre o con sueño sigue siendo un juez. Un autocompletador sin hambre sigue sin ser un juez. El hambre y el sueño no son defectos del razonamiento humano: son condiciones del razonamiento humano. Si la respuesta a la fatiga judicial es automatizar la función jurisdiccional, la pregunta no es sobre tecnología: es sobre cuántos jueces y con qué condiciones de trabajo opera el sistema. Pero esa pregunta es incómoda, costosa y política. Un servidor de 17 millones de pesos es más fotogénico que una reforma presupuestal.

Para la conversación pública mexicana sobre IA y derecho

Lo urgente no es celebrar sino exigir transparencia: qué modelo, qué datos, qué evaluación, qué proceso de contratación, qué mecanismo de auditoría independiente, qué derecho tiene el justiciable a saber que su sentencia fue asistida por un autocompletador de texto y a cuestionar esa asistencia. Porque ese sesgo de automatización existe, y no se va a ir a ningún lado. Me resulta particularmente molesto que toda la conversación gire en torno a lo técnico, cuando muy poco se habla de lo organizacional, es decir, más allá de la obligación del juez de revisar y decir que lo hizo: ¿a qué se parece realmente este proceso y en qué medida el juez sigue determinando la solución del asunto? Porque ahí está el dilema sin salida:

- Si el juez revisa de verdad estos casos simples, es decir, relee el expediente, verifica los hechos, reconstruye el silogismo jurídico, evalúa si la ponderación de la prueba es correcta, confirma que la norma aplicable es la adecuada, entonces hizo todo el trabajo que SON-IA supuestamente le ahorra. La eficiencia desaparece. El «acuerdo cada minuto y medio»4 se convierte en un acuerdo cada minuto y medio más una hora de revisión real. Y SON-IA se reduce a un procesador de texto con ínfulas.

- Si el juez no revisa de verdad, que es el escenario realista, el que justifica la inversión, el que produce la reducción anunciada de hasta 60% en tiempos, entonces lo que determina el contenido de la sentencia no es el juicio del juzgador sino la predicción estadística de un modelo. Y la leyenda obligatoria «revisada y validada por una persona juzgadora» se convierte en una ficción institucional.

Estas preguntas tocan directamente a otras, más fundamentales: ¿por qué y para qué hacer esta implementación? ¿Qué modelo de sociedad se está empujando?

El servidor está en Querétaro

Querétaro hizo algo valioso: demostró que un poder judicial estatal mexicano puede implementar IA generativa con lineamientos previos, piloto controlado y supervisión humana obligatoria. Eso es más de lo que la mayoría de las instituciones del país han logrado.

Pero la pregunta que nadie formuló antes de firmar esas dos sentencias es la más importante de todas: ¿cuándo decidimos que la justicia es un problema de predicción del próximo token? ¿Quién autorizó esa premisa? ¿Y dónde queda la iuris prudentia, es decir, la prudencia del derecho y el juicio humano sobre lo justo, cuando la delegamos a un modelo que no juzga, sino que predice la próxima palabra?

El servidor está en Querétaro. Los datos no salen del tribunal. El cifrado es robusto. Los lineamientos son serios.

Pero el modelo nos robó la razón.

Footnotes

-

Poder Judicial del Estado de Querétaro, Boletín de prensa, 28 de abril de 2026. Disponible en: https://www.poderjudicialqro.gob.mx/noticias/despliegaBol.php?id=56519 ↩

-

Poder Judicial del Estado de Querétaro, Boletín de prensa, 20 de enero de 2026. Disponible en: https://www.poderjudicialqro.gob.mx/noticias/despliegaBol.php?id=56581 (referencia al lanzamiento formal de SON-IA). ↩

-

«Querétaro, primer Poder Judicial en México en emitir sentencias con apoyo de inteligencia artificial», Foro Jurídico, 28 de abril de 2026. Disponible en: https://forojuridico.mx/queretaro-primer-poder-judicial-en-mexico-en-emitir-sentencias-con-apoyo-de-inteligencia-artificial/ ↩

-

«Querétaro utiliza IA para emitir sentencias por primera vez en México», La Jornada, 29 de abril de 2026. Disponible en: https://www.jornada.com.mx/noticia/2026/04/29/estados/queretaro-utiliza-ia-para-emitir-sentencias-por-primera-vez-en-mexico ↩ ↩2 ↩3 ↩4 ↩5

-

«Por primera vez en México una inteligencia artificial ayudó a redactar dos sentencias judiciales en Querétaro», El Imparcial, 30 de abril de 2026. Disponible en: https://www.elimparcial.com/mexico/2026/04/30/por-primera-vez-en-mexico-una-inteligencia-artificial-ayudo-a-redactar-dos-sentencias-judiciales-en-queretaro-y-el-experimento-abrio-un-debate-urgente-sobre-que-tanto-puede-acelerar-la-justicia-sin-poner-en-manos-de-una-maquina-la-decision-final-de-jueces-y-juezas/ ↩ ↩2

-

«Poder Judicial de Querétaro firma primera sentencia con apoyo de Inteligencia Artificial», Diario de Querétaro, 28 de abril de 2026. Disponible en: https://oem.com.mx/diariodequeretaro/local/poder-judicial-de-queretaro-firma-primera-sentencia-con-apoyo-de-inteligencia-artificial-29715242 ↩ ↩2 ↩3 ↩4

-

Lineamientos para el uso responsable, ético y seguro de la Inteligencia Artificial en la administración de justicia, Consejo de la Judicatura del PJEQ, publicados en La Sombra de Arteaga, 24 de octubre de 2025. Disponible en: https://www.poderjudicialqro.gob.mx/biblio/leeDoc.php?cual=158007®lamentos=1 ↩ ↩2 ↩3

-

Putnam, H. (1967). The nature of mental states. In W. H. Capitan & D. D. Merrill (Eds.), Art, mind, and religion (pp. 37–48). University of Pittsburgh Press. ↩

-

Putnam, H. (1988). Representation and reality. MIT Press. ↩

-

Epstein, R. (18 de mayo de 2016). The empty brain. Aeon. https://aeon.co/essays/your-brain-does-not-process-information-and-it-is-not-a-computer ↩

-

Damasio, A. (2005). En busca de Spinoza: Neurobiología de la emoción y los sentimientos. Crítica. ↩

-

Sobre la insuficiencia del funcionalismo aplicado a los LLMs en el contexto jurídico, véase Prince Tritto, P. y Torres Ortega, I. C., «Jurists of the Gaps: Large Language Models and the Quiet Erosion of Legal Authority», Masaryk University Journal of Law and Technology, 2025. Disponible en: https://journals.muni.cz/mujlt/article/view/39797. ↩

-

«SON-IA: Querétaro activa inteligencia artificial en el Poder Judicial y se coloca a la vanguardia nacional», Códice Informativo, 20 de enero de 2026. Disponible en: https://codiceinformativo.com/2026/01/son-ia-queretaro-activa-inteligencia-artificial-en-el-poder-judicial-y-se-coloca-a-la-vanguardia-nacional/ ↩

-

«Querétaro dicta primera sentencia con inteligencia artificial en México», Código Qro, 28 de abril de 2026. Disponible en: https://codigoqro.mx/nota/local/2026/04/28/queretaro-dicta-primera-sentencia-inteligencia-artificial-mexico ↩

-

«IA llega a la justicia en Querétaro con SONIA; Polares digitaliza demandas desde mayo», Expreso Querétaro, 28 de abril de 2026. Disponible en: https://expresoqueretaro.com/2026/04/28/ia-llega-a-la-justicia-en-queretaro-con-sonia-polares-digitaliza-demandas-desde-mayo/ ↩

-

Ninguna fuente oficial consultada —boletines del PJEQ, entrevistas publicadas del magistrado presidente, lineamientos del Consejo de la Judicatura, notas de La Jornada, El Imparcial, Diario de Querétaro, Códice Informativo, Foro Jurídico, Visión Empresarial Querétaro— identifica el nombre o la versión del modelo de lenguaje utilizado. Verificación realizada entre el 28 y el 30 de abril de 2026. ↩