Le 28 avril 2026, le pouvoir judiciaire de l’État de Querétaro, au Mexique, a signé les premières décisions élaborées avec l’aide d’une intelligence artificielle générative au Mexique : un divorce sans cause au sixième tribunal des affaires familiales et une procédure d’exécution commerciale au neuvième tribunal civil.1 Le système s’appelle SON-IA, fonctionne sur un serveur propre du tribunal et utilise un grand modèle de langage (LLM en anglais) pour structurer des décisions à partir de dossiers électroniques.2 Le magistrat-président l’a présenté comme un fait inédit au Mexique et en Amérique latine.3

Et en effet, c’est inédit, au Mexique. Mais la conversation publique qui l’entoure se concentre sur la mauvaise question.

Ce dont tout le monde discute

La couverture médiatique, de La Jornada4 à Foro Jurídico5 en passant par El Imparcial6 et les médias locaux, se concentre sur deux thèmes : la sécurité des données et la promesse que l’IA ne remplace pas le juge. La belle affaire. Pour le premier, L’État du Querétaro a choisi d’héberger le système sur un serveur propre, avec chiffrement et sans dépendance vis-à-vis de plateformes commerciales en cloud.7 Pour le second, les Lignes directrices pour un usage responsable de l’IA, publiées dans La Sombra de Arteaga le 24 octobre 2025, établissent que toute décision assistée doit être révisée et validée par un juge, avec une mention obligatoire qui le certifie.8

Les deux sujets sont pertinents. Mais aucun ne touche au problème de fond.

Ce que personne ne demande

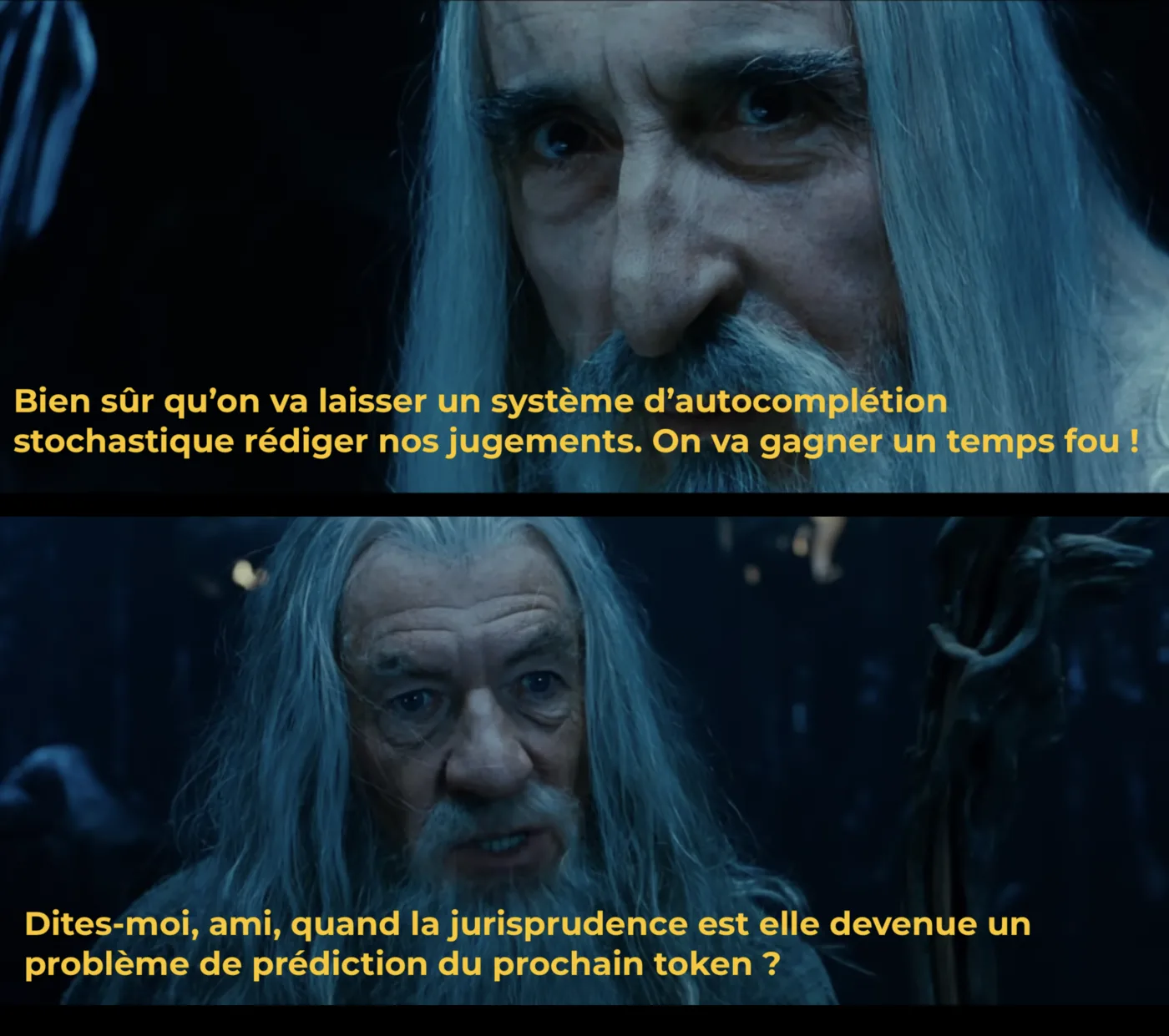

Un LLM ne raisonne pas. Il permet de prédire quelle séquence de tokens est statistiquement la plus probable étant donné un contexte. J’aime le répéter même si ça en agace certains : c’est un perroquet stochastique. Littéralement. Je m’inscris en faux face au récit des capacités émergentes que les disciples de la Silicon Valley répètent à l’envie. Quand on demande à une IA de structurer une décision, on n’applique pas le droit à des faits. On génère un texte qui ressemble à ce à quoi une décision ressemble dans un corpus d’entraînement. La différence est invisible dans le résultat… jusqu’à ce qu’elle ne le soit plus. Parce que la nature même de l’opération en fait une erreur épistémique, qui produit nécessairement une érosion de la justice.

La jurisprudence au sens classique, romain, celui dont le Mexique a hérité, signifie iuris prudentia : la prudence du droit, le jugement raisonné sur le juste dans un cas concret. Elle implique l’interprétation de la norme, l’appréciation de la preuve, la pondération de principes en tension, un syllogisme juridique qui relie prémisse majeure (norme), prémisse mineure (faits) et conclusion (décision), dans un mouvement et une expérience d’une réalité sociale partagée par une personne de chair et d’os, qui signe et comprend ce que cela pourrait être de se trouver de l’autre côté du miroir. Chacune de ces étapes est un acte de jugement, lequel est fondamentalement différent d’un acte de prédiction sémantique.

Quand on substitue à cet acte de jugement une prédiction statistique du prochain token, ce que l’on obtient est une décision qui sonne juste mais qui a été générée plutôt que raisonnée, ce qui contrevient au respect du procès équitable. Et le juge qui la révise et la valide ne vérifie pas un raisonnement, puisqu’il n’y a pas eu de raisonnement, mais il vérifie si le texte lui paraît raisonnable. Ce qui est exactement ce qu’un LLM est optimisé à produire : du texte qui paraît raisonnable. La circularité rhétorique de tout cela serait esthétique si ce n’était pas si dramatique que ça se produise dans l’exercice d’une activité régalienne de l’État.

La fonction juridictionnelle consiste dans l’exercice du jugement sur un cas concret. Un prédicteur de tokens exerce quelque chose de radicalement distinct : il produit la réponse la plus plausible, pas la plus juste. Et alors, me dira-t-on, si le résultat est indiscernable de la simulation ? Le fonctionnalisme nous dit que tout va bien !

Non. Le fonctionnalisme ne nous dit pas que tout va bien.

D’abord, même le père du fonctionnalisme ne soutiendrait pas une telle chose : Hilary Putnam a formulé sa thèse en 19679 et l’a abandonnée lui-même vingt ans plus tard,10 en concluant que les états fonctionnels ne peuvent rendre compte des propriétés centrales des états mentaux (croyance, raisonnement, rationalité), c’est-à-dire, de la capacité à former et à posséder des raisons et pas seulement de produire des sorties qui ressemblent à des raisons.

Ensuite, même si l’on acceptait la prémisse fonctionnaliste, un LLM ne la satisfait pas : Putnam décrivait les états mentaux comme des états d’un système complet qui servent de lien causaux entre des entrées, des états internes persistants et des sorties dans le temps. Un transformer a un prompt, une forward pass et des tokens. Comme l’affirme un essai d’Aeon qui s’apprête à fêter ses dix ans, nos cerveaux ne fonctionnent pas comme des ordinateurs !11 Get over it. Les ordinateurs n’ont pas d’états internes servant de médiateurs entre plusieurs interactions. Pas d’intégration systémique. Pas de corps.

Et enfin, le neurologue Antonio Damasio a démontré empiriquement avec des patients atteints de lésions ventro-médianes qu’il n’existe pas de raisonnement pur détaché des marqueurs somatiques : même pour la logique formelle, l’analyse juridique ou la stratégie, les humains ont besoin de signaux émotionnels pour évaluer la pertinence, hiérarchiser les options et détecter les contradictions significatives.12 Un LLM permet de produire des sorties que nous évaluons comme logiquement correctes, mais nous ne faisons que récupérer des motifs statistiques. En d’autres termes : le raisonnement humain implique d’évaluer la signifiance. Avec l’IA, nous manipulons des symboles. Et certains, impressionnés par cela, confondent la carte et le territoire. Confondre l’utilité fonctionnelle d’un autocomplèteur avec le processus cognitif consistant à juger est précisément la confusion catégorielle sur laquelle se construit SON-IA, et bien d’autres usages d’IA dégénérative dans la justice.13 J’approfondis cet argument, avec Ilsse C. Torres Ortega, dans mon dernier paper de recherche — disponible aux côtés de mes autres travaux dans mes publications.

Ce que nous savons (et ne savons pas) sur SON-IA

Il faut être précis : le pouvoir judiciaire du Querétaro a fait quelque chose qu’aucune autre institution judiciaire au Mexique n’a osé faire, et l’a fait avec plus de structure que ce que la couverture médiatique laisse percevoir.14 Il a publié des lignes directrices éthiques avant l’implémentation,8 mené un pilote de six mois dans deux tribunaux spécifiques,15 défini un périmètre limité aux affaires de faible complexité (divorce pour altération définitive du lien conjugal, matière gracieuse, injonctions de payer),16 et établi la supervision humaine obligatoire comme condition normative. Rien de tout cela n’est trivial.

Plusieurs questions fondamentales restent toutefois sans réponse publique :

Quel problème cherche-t-on à résoudre, et l’IA générative est-elle le bon outil pour cela ? Parce que je n’ai vu nulle part un quelconque signe que des technologies alternatives, des solutions low tech, voire des technologies plus robustes comme des algorithmes d’IA neurosymbolique sur mesure aient été envisagées.

Quel modèle est utilisé ? Aucun communiqué officiel, aucun bulletin du tribunal des six derniers mois, aucune entrevue du magistrat-président n’identifie le modèle de langage sous-jacent.17 Nous savons que ce n’est ni ChatGPT, ni Gemini, ni Claude, expressément interdits par l’institution.7 Nous savons qu’il opère sur un serveur local. Mais il n’a pas été publié s’il s’agit de Llama, Mistral, Qwen ou d’un autre modèle open source. Savoir quel modèle produit les décisions est une condition minimale pour évaluer ses biais. La question d’une éventuelle violation des Lignes directrices pour un usage responsable de l’IA, dont le pilote se réclame, est réelle.

Que signifie « entraînement de six mois » ? Le magistrat-président a déclaré : « entrenamos a nuestro robot durante seis meses para estar siendo especializado en derecho » (« nous avons entraîné notre robot pendant six mois pour qu’il soit spécialisé en droit »).4 Mais la juge titulaire du sixième tribunal des affaires familiales décrit le processus en termes plus concrets : « hemos desarrollado prompts para tres tipos de resoluciones » (« nous avons développé des prompts pour trois types de résolutions »).7 Il y a une distance technique énorme entre entraîner un modèle (modifier ses poids avec de nouvelles données) et développer des prompts (écrire des instructions pour un modèle existant). La documentation publique ne permet pas de distinguer laquelle des deux choses s’est produite.

Qui a évalué la qualité ? Le magistrat-président a déclaré qu’après les essais pilotes, le système permet d’émettre des documents « con alta pulcritud » (« avec une grande propreté »)6 et a affirmé en une autre occasion qu’on les fait « con perfección sin sesgos » (« avec perfection sans biais »).4 Ces affirmations ne sont étayées par aucune évaluation indépendante publiée. Pas de benchmarks, pas de comparaison en aveugle entre décisions humaines et décisions assistées, pas d’audit tiers. Les lignes directrices elles-mêmes confient le suivi à la Direction des TI, c’est-à-dire à la même équipe qui a construit le système.8 Évaluer son propre produit, c’est simplement du marketing. Et n’importe quel étudiant de licence en science des données peut sentir le piège quand on déclare qu’il n’y a ni biais ni hallucinations dans un modèle d’IA générative.

Le problème que le serveur local ne résout pas

La décision du Querétaro d’opérer avec une infrastructure propre plutôt que de dépendre d’un fournisseur de cloud étatsunien est cohérente du point de vue de la souveraineté des données. Un pouvoir étatique ne devrait pas dépendre contractuellement d’OpenAI, d’AWS ou de Google pour la garde des dossiers judiciaires de ses citoyens. Un bon point.

Mais on peut faire une différence entre souveraineté des données et souveraineté cognitive.

Le serveur est au Querétaro. Mais le modèle (quel qu’il soit) qui est appliqué sur les dossiers a été entraîné majoritairement sur du texte en anglais et sur des corpus juridiques anglo-saxons. Les LLM actuels, même ceux qui sont open source, reproduisent généralement des logiques de common law : précédent contraignant, système contradictoire, standard de reasonableness, stare decisis. Le système juridique mexicain opère selon une autre logique : codification, principe de légalité, jurisprudencia constante, le juge comme applicateur de la norme, etc.

Quand on utilise SON-IA pour fixer le litige ou pondérer la preuve, avec quelle logique le fait-on ? Privilégie-t-on le précédent sur la norme ? Structure-t-on le syllogisme juridique comme le ferait un juge formé en tradition civile, ou comme le ferait un modèle qui a lu des millions de rulings fédéraux étatsuniens ? Ces questions ne se résolvent pas avec un serveur on-premises refroidi à l’air (argument qui a été mentionné pour justifier que la question avait été pensée à fond).4

Et il y a un facteur aggravant : ce biais ne se manifeste pas comme une erreur de fait que le juge pourrait détecter. Ce n’est pas une date erronée ni une loi mal citée. C’est une manière de structurer l’argument, de pondérer les éléments, d’organiser la décision, de prioriser les sources de droit. Il est invisible précisément parce que le LLM est optimisé à produire du texte qui paraît correct. Mais le risque réside dans l’abandon de la fonction de juger, parce qu’écrire une décision, c’est décider, de première main, ce qu’elle doit contenir et pourquoi. Et je crois que c’est la première fois dans l’histoire qu’un juge, dont la fonction est d’écrire le droit ou de le rendre parfait, accepte de laisser la main et de se transformer en réviseur de quelque chose écrit de façon automatique. En invoquant l’efficacité. Avec la question de savoir si réellement, l’écriture de la décision était le goulot d’étranglement en termes d’efficacité de la justice. Mais ça, c’est une question pour un autre article.

La pente glissante

Le scandale n’est pas dans les divorces. Il est dans ce qui vient ensuite. Le magistrat-président a déjà annoncé l’extension à d’autres tribunaux et mentionné explicitement la matière pénale.7 La logique est prévisible : si ça fonctionne pour les divorces, pourquoi pas pour les pensions alimentaires ? Si ça fonctionne pour les injonctions de payer, pourquoi pas pour les contentieux complexes ? Chaque succès apparent à un échelon de faible complexité devient justification pour monter au suivant. Surtout que, “l’IA progresse”.

Et c’est ici qu’entre en jeu le mirage des scaling laws : l’idée que les modèles, en croissant en paramètres, deviennent progressivement plus intelligents. Les sorties s’améliorent, certes : elles deviennent plus difficiles à distinguer du texte humain. Mais améliorer la prédiction du prochain token, ce n’est pas acquérir une capacité de jugement. La brèche entre simulation et jugement ne se referme pas avec plus de paramètres, parce qu’elle est basée sur une différence de nature, pas de degré.

La pression est réelle, mais la réponse à un système judiciaire surchargé n’est pas d’automatiser le jugement, mais bien d’automatiser tout ce qui entoure le jugement (recherche, transcription, gestion documentaire, anonymisation — et d’ailleurs ce dernier point est aussi attaqué au Querétaro avec SON-IA), sans déléguer l’acte de juger à un processus qui, par définition, ne juge pas.

Ce que le débat devrait inclure

La couverture de SON-IA oscille entre deux pôles : l’enthousiasme acritique et la peur générique. Ni l’un ni l’autre ne touche aux questions importantes de mon point de vue, que je vais détailler maintenant.

Pour les institutions étatiques voulant adopter l’IA dans la fonction juridictionnelle

Les questions sont de nature épistémique : la prédiction statistique de tokens est-elle compatible avec l’obligation constitutionnelle de motiver les décisions ? Un justiciable peut-il contester le raisonnement d’une décision qui… n’a pas été raisonnée ? Parce qu’évidemment, il y aura des décisions qui ne passeront même pas par le filtre de la révision d’un juge qui, par souci d’efficacité ou pour toute autre raison, s’en tamponnera simplement d’un révisé. On me dira que les juges délèguent déjà à des assistants juridiques, qu’ils utilisent déjà des modèles types sans réviser, qu’ils commettent déjà des erreurs ; alors qu’y a-t-il de mal à déléguer à une machine ?

Bien sûr, tout dépend de comment le modèle est utilisé. Mais dans sa version générative basique, ce qu’il y a de mal, c’est que cela change la nature du problème. Un assistant qui rédige une décision mal motivée raisonne mal : il a identifié des faits, tenté d’appliquer une norme, construit un syllogisme déficient. Son erreur est corrigible parce que c’est une erreur de jugement. Utiliser un LLM pour générer une décision plausible, c’est ne pas raisonner du tout. La sortie est une prédiction statistique déguisée en jugement. Et quand le juge signe sans réviser (ce qui, accordons-le, arrive déjà), dans un cas il a délégué son jugement à un autre être humain qui, au moins, l’a exercé. Dans l’autre, il l’a délégué à un processus qui par définition ne peut pas l’exercer. Le problème ne s’améliore pas avec l’IA : il se blanchit et se cache derrière le technosolutionnisme. Précisément parce que la décision générée avec un LLM paraît plus propre, plus structurée, plus correcte que celle de l’assistant épuisé, c’est exactement ce qui la rend plus dangereuse. Un juge qui s’ennuie, qui a faim ou sommeil reste un juge. Un autocomplèteur qui n’a pas faim continue de ne pas être un juge. La faim et le sommeil ne sont pas des défauts du raisonnement humain : ce sont des conditions du raisonnement humain. Si la réponse à la fatigue judiciaire est d’automatiser la fonction juridictionnelle, la question n’est pas technologique : elle porte sur le nombre de juges et leurs conditions de travail. Mais cette question est inconfortable, coûteuse et politique. Un serveur de 17 millions de pesos est plus photogénique qu’une réforme budgétaire.

Pour la conversation publique mexicaine sur IA et droit

L’urgence n’est pas de célébrer mais d’exiger de la transparence : quel modèle, quelles données, quelle évaluation, quel processus de marché public, quel mécanisme d’audit indépendant, quel droit a le justiciable de savoir que sa décision a été assistée par un autocomplèteur de texte et de contester cette assistance. Parce que le biais d’automatisation existe, et il ne disparaîtra pas. J’ai été particulièrement interloqué que toute la conversation tourne autour du technique, alors que l’on parle très peu de l’organisationnel : au-delà de l’obligation du juge de réviser et de dire qu’il l’a fait, à quoi ressemble réellement ce processus et dans quelle mesure le juge continue-t-il de déterminer la solution de l’affaire ? Parce qu’il y a là un dilemme sans issue :

- Si le juge révise vraiment ces affaires simples, c’est-à-dire relit le dossier, vérifie les faits, reconstruit le syllogisme juridique, évalue si la pondération de la preuve est correcte, confirme que la norme applicable est la bonne, alors il a fait tout le travail que SON-IA est censé lui épargner. L’efficacité disparaît. Le « acuerdo cada minuto y medio » (« décision toutes les minutes et demie »)4 devient une décision toutes les minutes et demie plus une heure de révision réelle. Et SON-IA se réduit à un traitement de texte un peu prétentieux.

- Si le juge ne révise pas vraiment — scénario réaliste, celui qui justifie l’investissement, celui qui produit la réduction annoncée jusqu’à 60% des temps —, alors ce qui détermine le contenu de la décision n’est pas le jugement du juge mais la prédiction statistique d’un modèle. Et la mention obligatoire « révisée et validée par un juge » devient une fiction institutionnelle.

Ces questions en touchent d’autres, plus fondamentales : pourquoi et pour quoi faire cette implémentation ? Quel modèle de société est en train d’être poussé ?

Le serveur est au Querétaro

Le Querétaro a fait quelque chose de précieux : il a démontré qu’un pouvoir judiciaire d’un État mexicain peut implémenter de l’IA générative avec des lignes directrices préalables, un pilote contrôlé et une supervision humaine obligatoire. C’est plus que ce que la majorité des institutions du pays ont accompli.

Mais la question que personne n’a posée avant de signer ces deux décisions est la plus importante de toutes : à quel moment avons-nous décidé que la justice est un problème de prédiction du prochain token ? Qui a autorisé cette prémisse ? Et quid de la iuris prudentia, c’est-à-dire la prudence du droit et nos choix sur le juste, lorsque nous la déléguons à un modèle qui ne juge pas, mais prédit le prochain mot ?

Le serveur est au Querétaro. Les données ne sortent pas du tribunal. Le chiffrement est robuste. Les lignes directrices sont sérieuses.

Mais le modèle nous a volé la raison.

Footnotes

-

Pouvoir judiciaire de l’État de Querétaro, communiqué de presse, 28 avril 2026 [en espagnol]. Disponible sur : https://www.poderjudicialqro.gob.mx/noticias/despliegaBol.php?id=56519 ↩

-

Pouvoir judiciaire de l’État de Querétaro, communiqué de presse, 20 janvier 2026 [en espagnol]. Disponible sur : https://www.poderjudicialqro.gob.mx/noticias/despliegaBol.php?id=56581 (référence au lancement formel de SON-IA). ↩

-

« Querétaro, primer Poder Judicial en México en emitir sentencias con apoyo de inteligencia artificial », Foro Jurídico, 28 avril 2026 [en espagnol]. Disponible sur : https://forojuridico.mx/queretaro-primer-poder-judicial-en-mexico-en-emitir-sentencias-con-apoyo-de-inteligencia-artificial/ ↩

-

« Querétaro utiliza IA para emitir sentencias por primera vez en México », La Jornada, 29 avril 2026 [en espagnol]. Disponible sur : https://www.jornada.com.mx/noticia/2026/04/29/estados/queretaro-utiliza-ia-para-emitir-sentencias-por-primera-vez-en-mexico ↩ ↩2 ↩3 ↩4 ↩5

-

« Por primera vez en México una inteligencia artificial ayudó a redactar dos sentencias judiciales en Querétaro », El Imparcial, 30 avril 2026 [en espagnol]. Disponible sur : https://www.elimparcial.com/mexico/2026/04/30/por-primera-vez-en-mexico-una-inteligencia-artificial-ayudo-a-redactar-dos-sentencias-judiciales-en-queretaro-y-el-experimento-abrio-un-debate-urgente-sobre-que-tanto-puede-acelerar-la-justicia-sin-poner-en-manos-de-una-maquina-la-decision-final-de-jueces-y-juezas/ ↩ ↩2

-

« Poder Judicial de Querétaro firma primera sentencia con apoyo de Inteligencia Artificial », Diario de Querétaro, 28 avril 2026 [en espagnol]. Disponible sur : https://oem.com.mx/diariodequeretaro/local/poder-judicial-de-queretaro-firma-primera-sentencia-con-apoyo-de-inteligencia-artificial-29715242 ↩ ↩2 ↩3 ↩4

-

Lignes directrices pour un usage responsable, éthique et sécurisé de l’intelligence artificielle dans l’administration de la justice, Conseil de la magistrature du PJEQ, publiées dans La Sombra de Arteaga, 24 octobre 2025 [en espagnol]. Disponible sur : https://www.poderjudicialqro.gob.mx/biblio/leeDoc.php?cual=158007®lamentos=1 ↩ ↩2 ↩3

-

Putnam, H. (1967). The nature of mental states. In W. H. Capitan & D. D. Merrill (Eds.), Art, mind, and religion (pp. 37–48). University of Pittsburgh Press. ↩

-

Putnam, H. (1988). Representation and reality. MIT Press. ↩

-

Epstein, R. (18 mai 2016). The empty brain. Aeon. https://aeon.co/essays/your-brain-does-not-process-information-and-it-is-not-a-computer ↩

-

Damasio, A. (2003). Spinoza avait raison : joie et tristesse, le cerveau des émotions. Odile Jacob. ↩

-

Sur l’insuffisance du fonctionnalisme appliqué aux LLM dans le contexte juridique, voir Prince Tritto, P. et Torres Ortega, I. C., « Jurists of the Gaps: Large Language Models and the Quiet Erosion of Legal Authority », Masaryk University Journal of Law and Technology, 2025. Disponible sur : https://journals.muni.cz/mujlt/article/view/39797. ↩

-

« SON-IA: Querétaro activa inteligencia artificial en el Poder Judicial y se coloca a la vanguardia nacional », Códice Informativo, 20 janvier 2026 [en espagnol]. Disponible sur : https://codiceinformativo.com/2026/01/son-ia-queretaro-activa-inteligencia-artificial-en-el-poder-judicial-y-se-coloca-a-la-vanguardia-nacional/ ↩

-

« Querétaro dicta primera sentencia con inteligencia artificial en México », Código Qro, 28 avril 2026 [en espagnol]. Disponible sur : https://codigoqro.mx/nota/local/2026/04/28/queretaro-dicta-primera-sentencia-inteligencia-artificial-mexico ↩

-

« IA llega a la justicia en Querétaro con SONIA; Polares digitaliza demandas desde mayo », Expreso Querétaro, 28 avril 2026 [en espagnol]. Disponible sur : https://expresoqueretaro.com/2026/04/28/ia-llega-a-la-justicia-en-queretaro-con-sonia-polares-digitaliza-demandas-desde-mayo/ ↩

-

Aucune source officielle consultée — bulletins du PJEQ, entrevues publiées du magistrat-président, lignes directrices du Conseil de la magistrature, articles de La Jornada, El Imparcial, Diario de Querétaro, Códice Informativo, Foro Jurídico, Visión Empresarial Querétaro — n’identifie le nom ou la version du modèle de langage utilisé. Vérification effectuée entre le 28 et le 30 avril 2026. ↩